Cloudgiganternes GPU-model slår AI-innovation ihjel

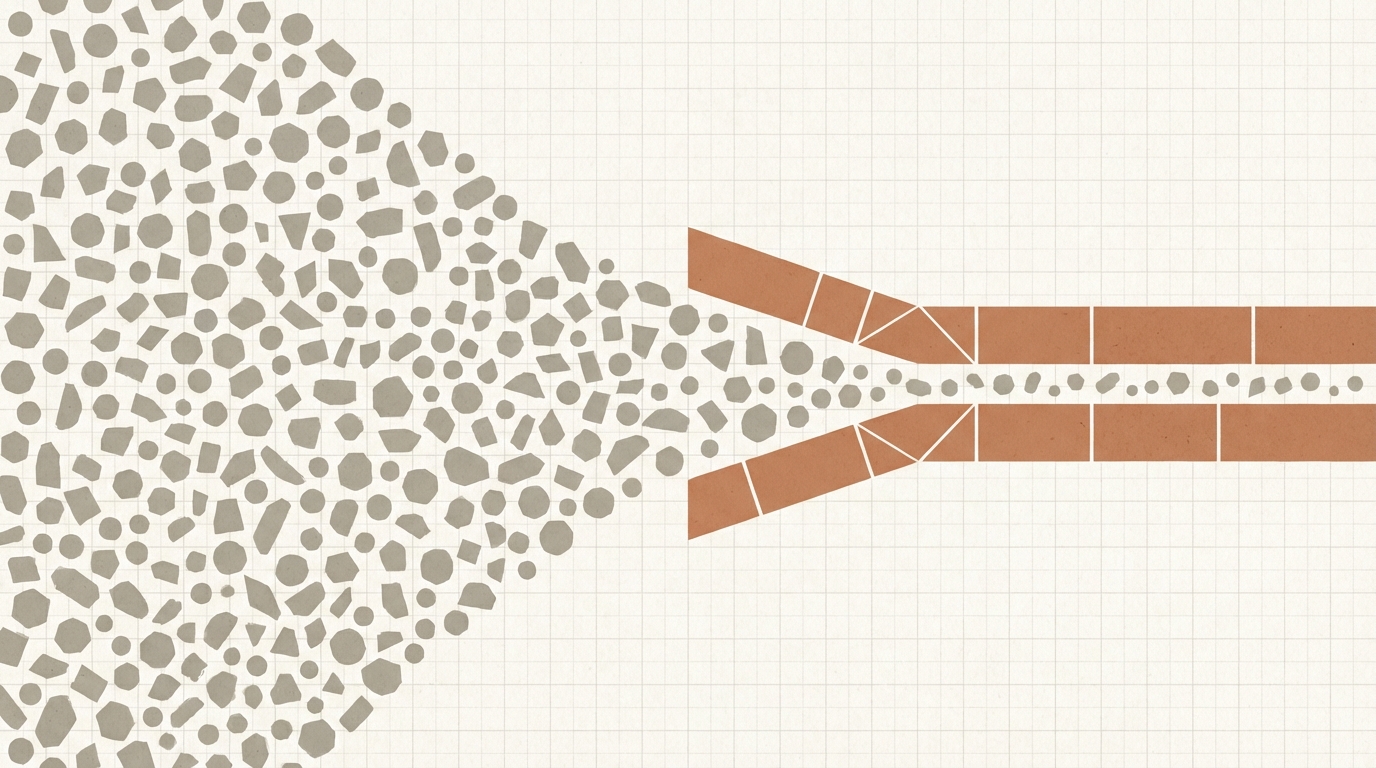

Månedlange GPU-køer er nu den primære flaskehals for enterprise AI. Hyperscale cloud er ikke svaret — og det er et strategisk problem.

Månedlange GPU-køer: Når infrastrukturen er langsommere end idéen

Der er en ironisk sandhed gemt i de fleste enterprise AI-programmer: virksomhederne mangler ikke ambition, data eller idéer. De mangler adgang til den hardware, der kan teste dem. QumulusAI og HyperFRAME Research har sat tal på frustrationen: infrastrukturmangel er nu den primære flaskehals for enterprise AI-initiativer, og teams venter rutinemæssigt flere uger – eller måneder – på at få adgang til GPU-kapacitet til eksperimenter og udvikling. Det er ikke et niche-problem for tech-giganter med eksotiske AI-projekter. Det er en hverdagsvirkelighed for enhver virksomhed, der forsøger at bevæge sig fra AI-idé til AI-produkt i et tempo, der er konkurrencedygtigt. Og den herskende model – hyperscale cloud-reservationer med lange forpligtelseshorisonter – er ikke svaret på det problem.

Hvorfor hyperscale cloud ikke løser flaskehalsen

Det er en udbredt antagelse, at cloud er svaret på AI-infrastrukturproblemer. Har du brug for GPU-kapacitet? Klik på AWS, GCP eller Azure og sæt det op. Virkeligheden er mere kompleks – og QumulusAIs rapport dokumenterer præcist, hvorfor hyperscale cloud i mange tilfælde ikke løser det problem, virksomhederne faktisk har.

Problemet er strukturelt. De store cloud-udbydere er optimeret til at levere stor, forudsigelig kapacitet til virksomheder, der ved, hvad de vil bruge. Hyperscale cloud er designet til produktion, ikke til eksperimenter. Reservationsmodeller kræver lange forpligtelseshorisonter. Spot-instanser er upålidelige og afbrydes, når kapaciteten er nødvendig andetsteds. On-demand GPU-kapacitet i de specialiserede konfigurationer, der er nødvendige for avancerede AI-workloads, er sjældent tilgængeligt med øjeblikkelig levering.

Resultatet er, at AI-teams, der ønsker at eksperimentere og iterere hurtigt, enten betaler præmiepriser for reserveret kapacitet, de kun bruger intermitterende, eller venter i en kø på adgang til den kapacitet, de faktisk har brug for. Ingen af delene er optimalt for en organisation, der ønsker at bevæge sig fra idé til produkt i et konkurrencedygtigt tempo.

Hyperspeed Compute som alternativ model – og hvad det kræver at evaluere den

QumulusAIs svar er det, de kalder Hyperspeed Compute: en infrastrukturmodel designet til at supplere hyperscale cloud med hurtigere, mere fleksibel adgang til GPU-kapacitet specifikt til eksperimentering og udvikling. Idéen er, at enterprise AI-workflows har to fundamentalt forskellige profiler:

- Produktion: Forudsigelig, kontinuerlig workload med behov for stabil kapacitet over tid. Her er hyperscale cloud-reservationer velegnede.

- Eksperimentering og udvikling: Burst-agtig, uforudsigelig workload med behov for øjeblikkelig adgang til GPU-kapacitet, som ikke kan planlægges måneder i forvejen. Her er de eksisterende cloud-modeller problematiske.

Hyperspeed Compute-modellen adresserer den anden kategori: on-demand GPU-adgang uden lange reservationsforpligtelser, designet til teams, der eksperimenterer og itererer. For virksomheder, der evaluerer denne type løsning, er der tre kritiske evalueringspunkter:

- Latenstid fra anmodning til adgang: Det centrale løfte er hurtigere adgang end hyperscale cloud. Spørg konkret: hvad er den faktiske tid fra en GPU-anmodning til fuld kapacitet er tilgængelig? Og hvad er den garanterede SLA under peak-belastning?

- Hardwareaktualitet: AI-eksperimenter kræver typisk den mest avancerede tilgængelige GPU-generation. Sikr jer, at den alternative infrastruktururdbyder har adgang til og faktisk leverer den nyeste generation af hardware – ikke ældre kapacitet, der er billig, fordi den er forældet.

- Integration med eksisterende workflows: Alternative compute-udbydere er kun nyttige, hvis de integrer smidigt med de frameworks, pipelines og datamiljøer, jeres AI-teams allerede bruger. API-kompatibilitet og workflow-integration er afgørende evalueringspunkter.

Den strategiske konsekvens: AI-hastighedsgabet er ved at blive konkurrencerelevant

Virksomheder, der kan eksperimentere med AI-idéer hurtigt, vil producere mere fungerende AI-applikationer hurtigere end dem, der venter i GPU-køer. Det er ikke en teknisk trivialitet – det er et direkte konkurrenceparameter. Den virksomhed, der kan teste og iterere en AI-use case på to uger frem for to måneder, vil markant hurtigere finde de løsninger, der leverer reel forretningsværdi. Og i et marked, der bevæger sig med den hastighed, AI-markedet gør, er to måneder forsinkelse ikke et marginalt ulempe. Det kan betyde, at konkurrenten er i markedet, inden I er færdige med at eksperimentere.

For danske virksomheder, der tager AI-innovation seriøst, er infrastrukturflaskehalsen dermed ikke blot et driftsanliggende. Det er et strategisk spørgsmål: har I den infrastruktur, der matcher den innovationshastighed, I ønsker at konkurrere med? Og hvis svaret er nej, er den næste spørgsmål: er det hyperscale cloud, alternativ compute eller en hybrid-model, der bedst løser det?

Konklusion: GPU-køen er ikke et teknisk problem. Det er et strategisk problem.

QumulusAIs rapport dokumenterer det, mange AI-teams allerede ved af erfaring: infrastruktur er den faktor, der oftest bremser AI-innovation i enterprise-kontekst. Og hyperscale cloud – trods sin enorme kapacitet – er ikke designet til det burst-agtige, eksperimentdrevne forbrug, der kendetegner tidlig AI-innovation.

Alternative infrastrukturmodeller som Hyperspeed Compute er ikke en erstatning for hyperscale cloud. De er et supplement, der adresserer et specifikt og reelt problem: hurtig adgang til GPU-kapacitet, når idéerne kræver det. For virksomheder, der ønsker at bevæge sig fra AI-ambition til AI-produkt i et konkurrencedygtigt tempo, er det en kategori af løsninger, der fortjener aktiv evaluering – ikke som en fremtidig mulighed, men som en nutidig nødvendighed.

Om Wiinholt AI

Wiinholt AI er et dansk AI-bureau med speciale i AI-drevet lead generation og automatisering. Vi hjælper virksomheder med at skalere deres salg og marketing ved hjælp af de nyeste AI-teknologier — fra intelligent outreach til automatiserede workflows.

Vil du vide mere om, hvordan vi kan hjælpe din virksomhed? Besøg os på www.wiinholt.dk eller kontakt os direkte for en uforpligtende snak.

Lær mere om Wiinholt AI →